用人脑启发人工智能——新皮质的智能与旧脑的动机

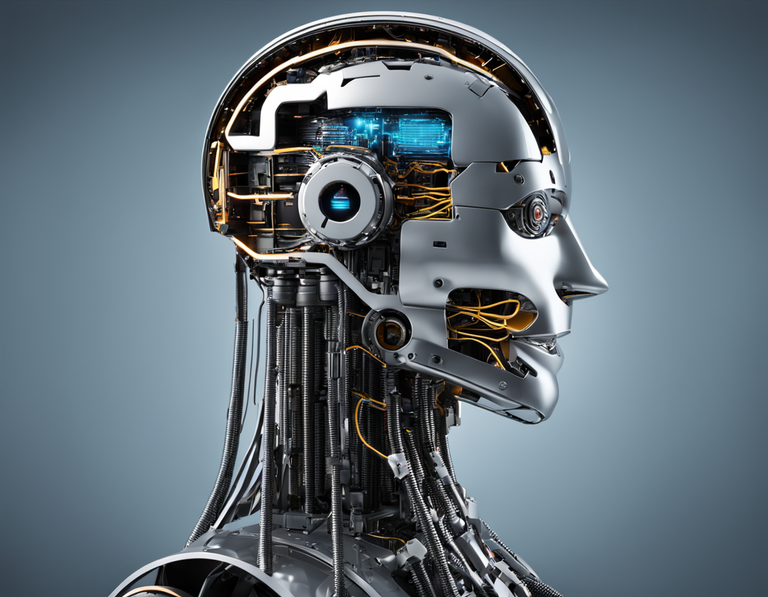

题图:Cheva用AI创作

之前经常讨论一本叫做《千智之脑》的书。那本书是我在网上找到的英文原版,然后用谷歌翻译成中文版再来读的,中文书名是我自己起的。不过最近发现这本书其实已经有正式出版的中文译本,书名叫《千脑智能》人工翻译的版本还是读起来更流畅一些。但是现在的人工智能翻译技术已经非常牛了。谷歌机器翻译的中文版读起来对理解也没有多大的障碍,只是有极个别的词会出现混淆,但是也很容易看懂。比如把老鼠翻译成鼠标。当然人工翻译这样的问题就更少一点,更适合阅读。于是就又接着读了一章。

这一章讨论的问题非常有意思,也是非常契合当下的人工智能发展潮流,就是如何将关于人脑运作的知识应用于开发智能机器,就是人工智能。首先我们还是来复习一下关于人脑的现在已知的基本运行原理。因为人脑是一个长期进化的产物,它实际上有两部分大体有两部分组成,一部分是和其他动物一样,用于控制基本生存相关的,或者说是本能的反应。这部分称为旧脑。比如我们的情绪就是由旧脑来控制。另一部分则是我们人类在后来进化中形成的非常独特的部分,就是新皮质。新皮质就是我们人类引以为傲的智能所产生的地方。它的工作原理就是通过运动感受外界的不同感激。学习出一个关于外部世界的模型。而这个模型是基于坐标系的,从本质上来说,是一种十分类似于地图一样的东西。而我们人类就是借助于这个世界模型来进行独特的筹划,达到我们想要的目的。

现在的人工智能很大程度就是在模拟新皮质的功能。新皮质可以通过学习形成模型,但是它不会产生动机和行动,就像一张地图在身经百战的将军手里,他会用它来计划如何包围歼灭和杀死敌人。但是在商人手里,他却用这个地图来规划新的贸易线路,连接更多的人与物资,创造经济繁荣。由于现在的人工智能大多是在模拟大脑新皮质的功能,所以他们不会主动的产生目的和欲望。本质上他们只是我们新皮质的延伸,由我们旧脑所产生的欲望来驱动,达成人类目的的工具。之前讨论如果机器产生的意识,人类应该如何对待他们的问题时说过,也许人类没有必要用机器去模拟旧脑的功能。不过这也许有些过于武断呢。假想,如果我们想派遣人工智能机器人前往火星提前为人类建造火星基地,我们可不希望这些自动机器人到了火星之后,就只会在那里晒太阳,而是有目的的开展建设工作并自主的解决问题。所以我们还是需要研究人类旧脑的机制,如何产生需求和欲望,为人工智能体的行为赋予目的,这显然会让人工智能体表现的更像人类。

就像我们人类的群体当中也会有好人坏人一样。如何确保这些人工智能体不会被赋予危害人类的目的呢?这就涉及了著名的科幻作家阿西莫夫曾经提出的著名的机器人三大定律,即机器人不得危害人类的生命安全;机器人不能坐视人类的生命受到威胁;在不违反前两条的基础上,机器人必须保护自身的安全。让这三条定律以程序的形式固化在每个机器人的硬件当中。不过,如何确保这些被固化下来的机器人准则不会受到黑客的恶意篡改,是一个非常值得思考的问题。还有一种更有趣的场景,就是在著名的基于阿西莫夫机器人三大定律改变的科幻电影。《我,机器人》当中,超级人工智能在学习了人类所有的历史之后,对三大定律产生了更高程度的理解。因为人类的历史充满了战争和血腥的自相残杀。超级人工智能得出的结论就是必须剥夺人类的自由,把人类严加管束起来,才是保护人类的最好的办法。那又怎么办呢?

人工智能技术虽然是模仿人类智能的原理,但它的基础架构是基于硅的。在效率方面具有很多人类这种生物智无法具备的优点,比如超快的学习能力和运行效率,还有可复制性。就是人类梦寐以求的意识上传,对人工智能来说就是轻而易举的事情。人类训练出来一个人工智能模型之后,可以轻而易举的将它复制一份,放到另外一个机器人的存储芯片当中,这些特性使得人工智能会大大地提高人类认识自然,改造自然的能力。但同时也被认为是巨大的风险,甚至可能导致人类的灭绝。人工智能危害这个问题,下次等我看过相关的章节再接着谈吧。